Di Maris Matteucci

Il tema della prevenzione del crimine è particolarmente caro a AIDA che punta però a qualcosa di ancora più sottile con il suo progetto di ricerca europeo intitolato Artificial Intelligence and advanced Data Analytics for Law Enforcement Agencies (Intelligenza Artificiale e Analisi avanzata dei Dati per le Forze dell'Ordine - AIDA): la previsione dei crimini. Qualcosa che può suonare familiare ai fan del film “Minority Report”, con un Tom Cruise molto giovane nei panni del capitano John Anderton e un sistema, il “Precrimine”, che era così perfetto (all’apparenza) da consentire alla Polizia di evitare i crimini prima che questi accadessero nella realtà.

Insomma un traguardo ambizioso, quello di voler prevenire i crimini prevedendoli attraverso sofisiticati algoritmi di Machine Learning e di Intelligenza Artificiale in grado di scandagliare e analizzare le informazioni grazie a una piattaforma di analisi dei dati descrittiva e predittiva. Ma per centrare il risultato, tutt’altro che dettato dal mero sviluppo di tecnologie, seppur innovative, AIDA ha deciso di “lavorare” su una moltitudine di aspetti. Uno di questi è incentrato sulla componente sociale. Ovvero cosa penserebbero le persone di un uso così importante dell’Intelligenza Artificiale al servizio dalle Forze dell’Ordine?

L’importanza della posta in palio ha indotto l’Unione Europea a finanziare il progetto di ricerca Europeo AIDA con quasi otto milioni di euro all’interno del programma Horizon 2020 (grant agreement n° 883596), partito ufficialmente a settembre 2020 e si concluderà a febbraio 2023, a 30 mesi di distanza.

In Italia il progetto è guidato da Engineering Ingegneria Informatica e vede Pluribus One, con sede a Cagliari, alla guida del Work Package incentrato sulla generazione di sistemi di IA per la gestione e l’acquisizione delle informazioni e per la contemporanea analisi dei gruppi criminali.

Il progetto AIDA mira a sviluppare una piattaforma di analisi dei dati e un insieme di strumenti ad hoc per contrastare in modo efficace le attività criminali. Senza però tralasciare la componente sociale, ovvero l’impatto che un utilizzo così massiccio dell’intelligenza artificiale da parte dei tutori dell’ordine pubblico potrebbe avere sui cittadini.

Per questo motivo, il progetto ha contemplato un primo sondaggio quantitativo a cui ne è seguito uno qualitativo che è andato a indagare più profondamente nel pensiero delle persone, per cercare di mettere a fuoco idee, paure, dubbi e tutto quello che può venire in mente quando si tira in ballo l’Intelligenza Artificiale in ambito sicurezza.

La prima parziale analisi dei sondaggi quantitativi (di cui vi abbiamo parlato in un precedente articolo) che sono stati compilati da 2850 persone in 11 diversi paesi europei ha evidenziato, per esempio che soprattutto in Estonia, Spagna e Inghilterra c’è una totale fiducia nelle Forze dell’Ordine e nel loro operato da parte dei cittadini. I risultati sono stati presentati dal partner CENTRIC, centro d'eccellenza nella ricerca contro il crimine e nel contrasto al terrorismo, con sede presso l’Università di Sheffield Hallam (Regno Unito), alla conferenza IKE’21 (20th Int'l Conf on Information & Knowledge Engineering)1.

L’obiettivo di AIDA è quello di mettere a disposizione delle Forze dell’Ordine un sistema e degli strumenti utili a aumentare la sicurezza mondiale. Ma non senza considerare l’impatto che un uso massiccio dell’IA potrebbe avere sulle persone comuni.

Ecco perché lo sviluppo della piattaforma e dei tool correlati sarà organizzato nel rispetto della privacy e terrà conto della componente etica dalla quale non si dovrebbe mai prescindere.

Il sondaggio qualitativo

Il sondaggio sull’IA utilizzata dalle Forze dell’Ordine ha coinvolto dieci nazioni in Europa, per un totale di circa 140 interviste a comuni cittadini.

Germania, Grecia, Olanda, Inghilterra, Spagna, Portogallo, Italia, Repubblica Ceca, Estonia e Romania hanno dunque preso parte in modo attivo a questa preziosa parte di ricerca che avrà un peso importante per capire che tipo di percezione hanno le persone su una tecnologia sempre più dirompente.

Videocamere, droni, monitoraggio online fanno ormai infatti parte del quotidiano. Ma sono tecnologie che mettono a disagio i cittadini? Oppure, per contro, questi si sentono più sicuri quando queste tecnologie vengono usate? E il fatto che le Forze dell’Ordine possano utilizzarle rappresenta un vantaggio o uno svantaggio se si pensa alla privacy?

Le domande sono state rivolte ai partecipanti che hanno potuto così spiegare le loro sensazioni, esprimendo anche dubbi e eventuali perplessità su un utilizzo dell’Intelligenza Artificiale che potrebbe non essere esente da criticità.

I dati emersi dal blocco di interviste in italiano condotte tra gli Over 65 ha messo in evidenza alcuni interessanti aspetti. Ovvero che ci sono diverse sfumature nella percezione che le persone hanno rispetto all’Intelligenza Artificiale usata dalle Forze dell’Ordine. Si passa da chi si fida e si fiderebbe ciecamente anche in caso di un uso più “stringente” di questa tecnologia, a chi invece nutre più di una perplessità e tira in ballo termini decisamente forti come quello di uno scenario poliziesco. Perché della Polizia si fiderebbe sì, ma con cautela.

E ancora, c’è chi già adesso si sente infastidito da un certo tipo di interferenza nella vita di tutti i giorni (videosorveglianza, monitoraggio online) e invece chi proprio perché “spiato” si sente in qualche modo più sicuro.

I dati, raccolti nazione per nazione, verranno analizzati e processati da CENTRIC e divulgati da EUROPOL, Ufficio Europeo di Polizia, partner di progetto e responsabile per la disseminazione dei risultati di ricerca ottenuti all’interno di AIDA.

Il tema della previsione del crimine dunque è più attuale che mai ma ancora c’è molto da lavorare in questa direzione. Con buona pace degli appassionati di “Minority Report” che probabilmente dovranno attendere ancora un po’ di tempo prima di assistere al concretizzarsi di una piattaforma in stile “Precrimine”.

1 L’articolo scientifico (P.S. Bayerl, B. Akhgar, E. La Mattina, B. Pirillo, I.Cotoi, D. Ariu, M.Mauri, J. Garcìa, D. Kavallieros, A. Kardara, K. Karagiorgou, “Strategies to counter Artificial Intellingence in Law Enforcement: Cross-Country Comparison of Citizens in Greece, Italy and Spain”) verrà pubblicato sul circuito Springer come conference proceeding.

Di Maris Matteucci, articolo originariamente pubblicato su Difesa Online.

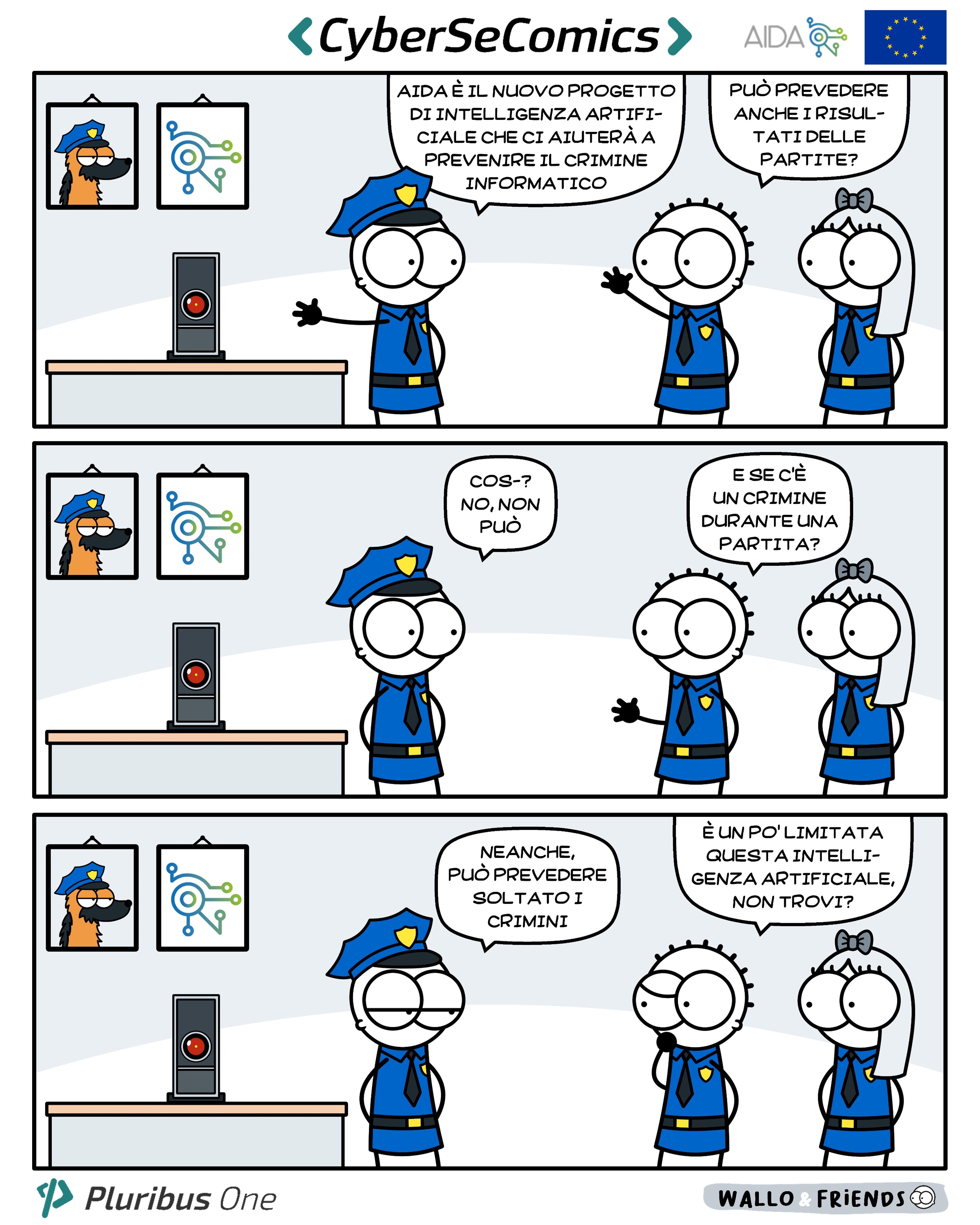

Questa pillola approfondisce il quattordicesimo episodio dei CyberSeComics di Pluribus One: CyberSeComics Ep. #14 - AIDA prevede (quasi) tutto.

La versione di questo episodio in lingua inglese è disponibile qui: CyberSeComics Ep. #14 - AIDA foresees (almost) everything.

Riportiamo la vignetta anche qui sotto.

Vuoi provare Pluribus One Web Application Security®?

Il nostro staff ti risponderà al più presto per programmare una demo.